لوس أنجليس (أ ف ب) – لم تخجل إدارة ترامب من مشاركة الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي عبر الإنترنت، واحتضنت صورًا وميمات شبيهة بالرسوم المتحركة وروجت لها على القنوات الرسمية للبيت الأبيض.

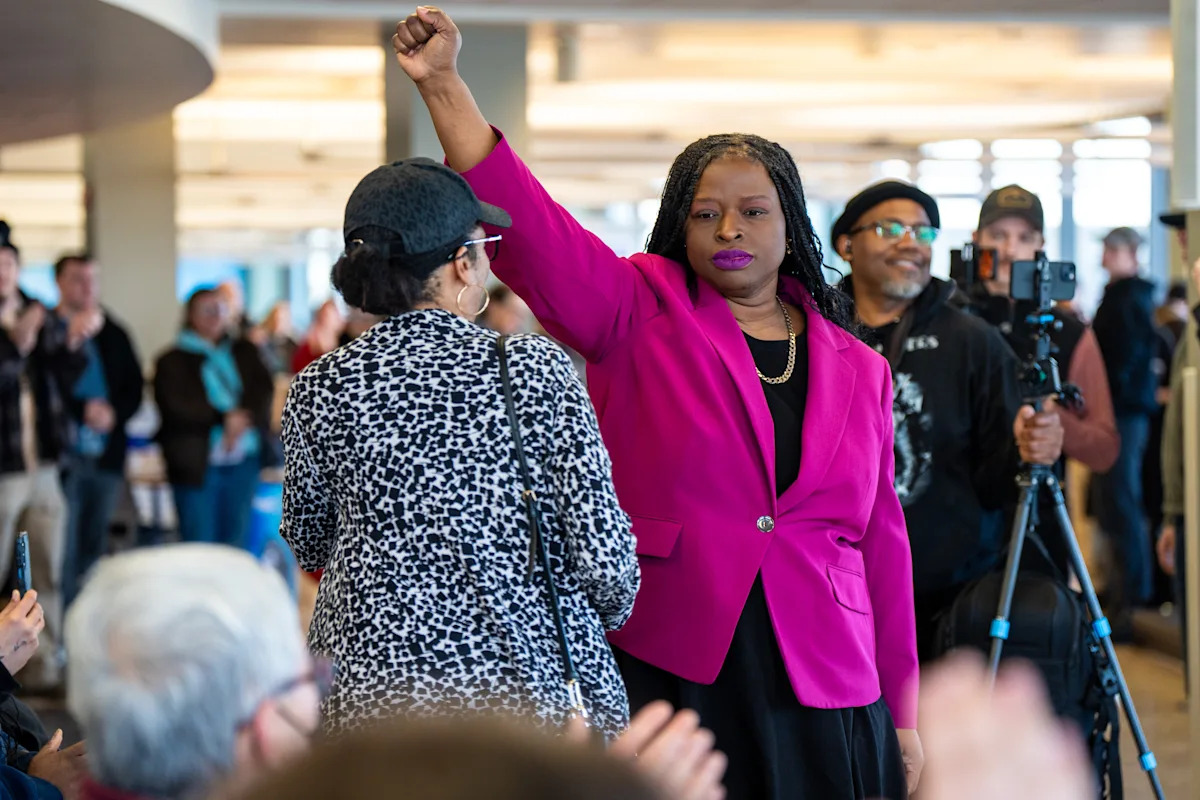

لكن الصورة المعدلة – والواقعية – لمحامية الحقوق المدنية نيكيما ليفي أرمسترونج وهي تبكي بعد إلقاء القبض عليها، تثير إنذارات جديدة حول كيفية طمس الإدارة للخطوط الفاصلة بين ما هو حقيقي وما هو مزيف.

ونشر حساب وزيرة الأمن الداخلي كريستي نويم الصورة الأصلية من اعتقال ليفي أرمسترونج قبل أن ينشر الحساب الرسمي للبيت الأبيض صورة معدلة تظهرها وهي تبكي. الصورة التي تم التلاعب بها هي جزء من طوفان من الصور المحررة بواسطة الذكاء الاصطناعي والتي تمت مشاركتها عبر الطيف السياسي منذ مقتل رينيه جود وأليكس بريتي على يد ضباط حرس الحدود الأمريكية في مينيابوليس.

ومع ذلك، فإن استخدام البيت الأبيض للذكاء الاصطناعي أثار قلق خبراء المعلومات المضللة الذين يخشون من أن يؤدي انتشار الصور التي تم إنشاؤها أو تحريرها بواسطة الذكاء الاصطناعي إلى تآكل الإدراك العام للحقيقة وزرع عدم الثقة.

ردًا على الانتقادات الموجهة إلى الصورة المعدلة ليفي أرمسترونج، ضاعف مسؤولو البيت الأبيض جهودهم في هذا المنشور، حيث كتب نائب مدير الاتصالات، كايلان دور، على موقع X أن “الميمات ستستمر”. كما شاركت نائبة السكرتير الصحفي للبيت الأبيض أبيجيل جاكسون منشورًا يسخر من الانتقادات.

يقول ديفيد راند، أستاذ علوم المعلومات في جامعة كورنيل، إن وصف الصورة المعدلة بأنها ميم “يبدو بالتأكيد بمثابة محاولة لتصويرها على أنها مزحة أو مشاركة فكاهية، مثل رسومهم الكاريكاتورية السابقة. ومن المفترض أن يهدف هذا إلى حمايتهم من الانتقادات لنشرهم وسائط تم التلاعب بها”. وقال إن الغرض من مشاركة صورة الاعتقال المعدلة يبدو “أكثر غموضا” من الصور الكاريكاتورية التي شاركتها الإدارة في الماضي.

لقد حملت الميمات دائمًا رسائل متعددة الطبقات تكون مضحكة أو مفيدة للأشخاص الذين يفهمونها، ولكن لا يمكن للغرباء فهمها. وقال زاك هنري، مستشار الاتصالات الجمهوري الذي أسس شركة Total Virality، وهي شركة تسويق مؤثرة، إن الصور المحسّنة أو المعدلة باستخدام الذكاء الاصطناعي هي مجرد أحدث أداة يستخدمها البيت الأبيض لإشراك شريحة من قاعدة ترامب التي تقضي الكثير من الوقت على الإنترنت.

وقال: “الأشخاص المتصلون بالإنترنت بشكل نهائي سوف يرونها ويتعرفون عليها على الفور باعتبارها ميمي”. “قد يراها أجدادك ولا يفهمون الميم، ولكن لأنها تبدو حقيقية، فإنها تقودهم إلى سؤال أطفالهم أو أحفادهم عنها.”

وقال هنري، الذي أشاد عمومًا بعمل فريق وسائل التواصل الاجتماعي في البيت الأبيض، إن الأمر سيكون أفضل إذا أثار رد فعل شرسًا، مما يساعد على انتشاره على نطاق واسع.

وقال مايكل سبايكس، الأستاذ في جامعة نورث وسترن والباحث في مجال محو الأمية الإعلامية الإخبارية، إن إنشاء ونشر الصور المعدلة، خاصة عندما تتم مشاركتها من قبل مصادر موثوقة، “يبلور فكرة عما يحدث، بدلا من إظهار ما يحدث بالفعل”.

وقال: “يجب أن تكون الحكومة مكانًا يمكنك الوثوق فيه بالمعلومات، حيث يمكنك القول إنها دقيقة، لأن لديهم مسؤولية القيام بذلك”. “من خلال مشاركة هذا النوع من المحتوى، وإنشاء هذا النوع من المحتوى… فإن ذلك يؤدي إلى تآكل الثقة – على الرغم من أنني دائمًا متشكك في مصطلح الثقة – ولكن الثقة التي يجب أن نحظى بها في حكومتنا الفيدرالية لتزويدنا بمعلومات دقيقة وموثقة. إنها خسارة حقيقية، وتقلقني كثيرًا حقًا.”

وقال سبايكس إنه يرى بالفعل “الأزمات المؤسسية” حول عدم الثقة في المؤسسات الإخبارية والتعليم العالي، ويشعر أن هذا السلوك من القنوات الرسمية يؤجج تلك القضايا.

قال راميش سرينيفاسان، الأستاذ في جامعة كاليفورنيا ومضيف بودكاست يوتوبيا، إن الكثير من الناس يتساءلون الآن عن المكان الذي يمكنهم اللجوء إليه للحصول على “معلومات موثوقة”. وقال: “إن أنظمة الذكاء الاصطناعي لن تؤدي إلا إلى تفاقم وتضخيم وتسريع هذه المشاكل المتمثلة في غياب الثقة، وغياب حتى فهم ما يمكن اعتباره حقيقة أو حقيقة أو دليلاً”.

قال سرينيفاسان إنه يشعر أن البيت الأبيض والمسؤولين الآخرين الذين يشاركون المحتوى الناتج عن الذكاء الاصطناعي لا يدعوون الأشخاص العاديين إلى الاستمرار في نشر محتوى مماثل فحسب، بل يمنحون أيضًا الإذن للآخرين الذين هم في مواقع المصداقية والسلطة، مثل صانعي السياسات، لمشاركة محتوى اصطناعي غير مسمى. وأضاف أنه بالنظر إلى أن منصات وسائل التواصل الاجتماعي تميل إلى “امتياز خوارزمي” للمحتوى المتطرف والتآمري – الذي يمكن لأدوات توليد الذكاء الاصطناعي إنشاؤه بسهولة – “فلدينا مجموعة كبيرة جدًا من التحديات بين أيدينا”.

لقد انتشر بالفعل تدفق مقاطع الفيديو التي أنشأها الذكاء الاصطناعي والمتعلقة بإجراءات الهجرة والجمارك والاحتجاجات والتفاعلات مع المواطنين على وسائل التواصل الاجتماعي. بعد إطلاق النار على رينيه جود على يد أحد ضباط إدارة الهجرة والجمارك أثناء وجودها في سيارتها، بدأت العديد من مقاطع الفيديو التي تم إنشاؤها بواسطة الذكاء الاصطناعي في الانتشار لنساء يقودن سياراتهن بعيدًا عن ضباط إدارة الهجرة والجمارك الذين طلبوا منهن التوقف. هناك أيضًا العديد من مقاطع الفيديو الملفقة التي يتم تداولها لمداهمات الهجرة ولأشخاص يواجهون ضباط إدارة الهجرة والجمارك، وغالبًا ما يصرخون عليهم أو يلقون الطعام في وجوههم.

قال جيريمي كاراسكو، منشئ محتوى متخصص في محو الأمية الإعلامية وفضح مقاطع فيديو الذكاء الاصطناعي واسعة الانتشار، إن الجزء الأكبر من مقاطع الفيديو هذه من المحتمل أن يأتي من حسابات “زراعة المشاركة”، أو تتطلع إلى الاستفادة من النقرات من خلال إنشاء محتوى باستخدام كلمات رئيسية ومصطلحات بحث شائعة مثل ICE. لكنه قال أيضًا إن مقاطع الفيديو تحظى بمشاهدات من أشخاص يعارضون ICE ووزارة الأمن الداخلي ويمكن أن يشاهدوها على أنها “خيال معجبين” أو ينخرطون في “تفكير بالتمني”، على أمل أن يشهدوا انتكاسة حقيقية ضد المنظمتين وضباطهما.

ومع ذلك، يعتقد كاراسكو أيضًا أن معظم المشاهدين لا يمكنهم معرفة ما إذا كان ما يشاهدونه مزيفًا، ويتساءل عما إذا كانوا سيعرفون “ما هو حقيقي أم لا عندما يكون الأمر مهمًا بالفعل، مثل عندما تكون المخاطر أعلى بكثير”.

حتى عندما تكون هناك علامات صارخة على ظهور الذكاء الاصطناعي، مثل لافتات الشوارع التي تحتوي على هراء أو أخطاء واضحة أخرى، فقط في “أفضل السيناريوهات” سيكون المشاهد ذكيًا بما يكفي أو يولي اهتمامًا كافيًا لتسجيل استخدام الذكاء الاصطناعي.

ولا تقتصر هذه القضية بالطبع على الأخبار المحيطة بإنفاذ قوانين الهجرة والاحتجاجات. انتشرت على الإنترنت في وقت سابق من هذا الشهر صور ملفقة ومحرفة عقب القبض على الزعيم الفنزويلي المخلوع نيكولاس مادورو. ويعتقد الخبراء، بما في ذلك كاراسكو، أن انتشار المحتوى السياسي الناتج عن الذكاء الاصطناعي سيصبح أكثر شيوعًا.

يعتقد كاراسكو أن التنفيذ الواسع النطاق لنظام العلامات المائية الذي يدمج معلومات حول أصل جزء من الوسائط في طبقة البيانات الوصفية الخاصة به يمكن أن يكون خطوة نحو الحل. قام التحالف من أجل مصدر المحتوى والأصالة بتطوير مثل هذا النظام، لكن كاراسكو لا يعتقد أنه سيتم اعتماده على نطاق واسع لمدة عام آخر على الأقل.

وقال: “ستكون هذه مشكلة إلى الأبد الآن”. لا أعتقد أن الناس يفهمون مدى سوء الأمر”.

__

ساهم في هذا التقرير الكاتبان في وكالة أسوشيتد برس جوناثان جيه كوبر في فينيكس وباربرا أورتوتاي في سان فرانسيسكو.

اترك ردك